źródło: shutterstock.com

źródło: shutterstock.comreklama

Gigant technologiczny znany jest z tego, że bardzo dba o bezpieczeństwo swoich użytkowników. Teraz, postanowił również wprowadzić nową opcję, której celem jest ochrona wizerunku dzieci. Tym samym, Apple miało sprzeciwić się pornografii. Niestety, teraz pojawiły się wątpliwości względem bezpieczeństwa wszystkich użytkowników urządzeń popularnego jabłuszka.

Apple wprowadza zmiany

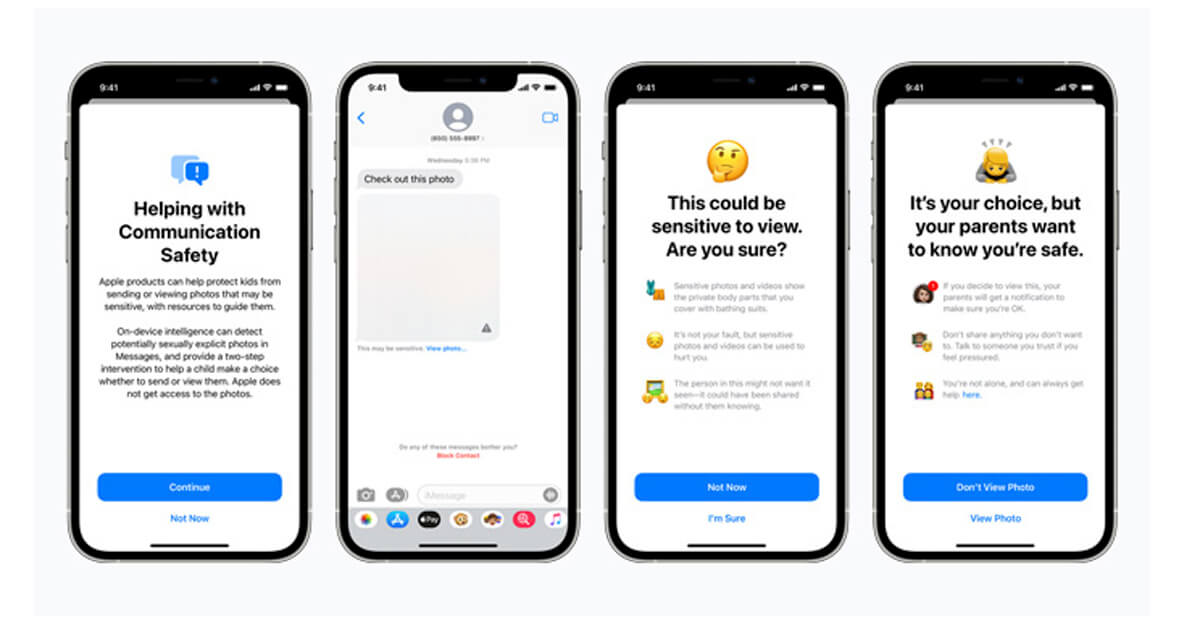

Kilka dni temu Apple poinformowało nas o zmianach, jakie wprowadzi w swoich urządzeniach. Mają one dotyczyć bezpieczeństwa najmłodszych, a tym samym ochrony ich przed pornografią oraz wykorzystywaniem seksualnym. Jak twierdzi sam gigant, funkcja obejmuje bezpieczeństwo dzieci w trzech obszarach. Pierwszym z nich, są zmiany w iMessage. Tu Apple zamierza skorzystać z maszynowego uczenia, aby informować użytkowników o poufnych danych, tym samym dając odbiorcom możliwość prywatnego odczytania wiadomości. Aby ten system działał, Apple stworzyło wcześniej bazę zdjęć składającą się z nieletnich osób, znajdujących się na urządzeniach zatrzymanych pedofili. Zatem gdy tylko sztuczna inteligencja wykryje podejrzane obrazy, zostanie to wychwycone. A w razie konieczności, zgłoszone odpowiednim służbom lub organizacjom zajmującym się bezpieczeństwem dzieci. Skanowanie tych obrazów nie będzie odbywało się chmurze, a w obrębie samego urządzenia. Tym samym gigant przyznaje, że przesyłane obrazy nie będą przesyłane do Apple ani innej firmy. Jak informuje Apple, ich algorytm działa z dokładnością jednego błędnego oznaczenia na bilion zdjęć. Nowa funkcja ma zostać wprowadzona pod koniec tego roku, wraz z aktualizacją iOS 15.

Wiadomości będą ostrzegać dzieci i ich rodziców o otrzymywaniu lub wysyłaniu zdjęć o charakterze jednoznacznie seksualnym. Źródło: apple.com

Kolejna zmiana dotyczyć ma systemów iOS i iPadOS. Apple chce bowiem wykorzystywać nowe aplikacje kryptograficzne, aby zaprzestać rozprzestrzenianiu się scamu, zachowując prywatność użytkowników. Tym samym, jego wykrycie umożliwi złapanie przestępców przez organy ścigania. Oznacza to, że Apple będzie z całą dokładnością oglądać zdjęcia użytkowników iCloud pod kątem pornografii dziecięcej. Gdy takowe zostanie znalezione, nastąpi weryfikacja firmy. Jeżeli wynik będzie pozytywny – konto użytkownika na iCloud zostanie zawieszone, a informacje o tym zdarzeniu dotrą do Narodowego Centrum Dzieci Zaginionych i Wykorzystywanych.

Według Apple, Siri zapewni zasoby i pomoc w zakresie wyszukiwania związanego z CSAM. Źródło: apple.com

Ostatnia zaś zmiana to aktualizacja Siri i wyszukiwarki. Mają one być pomocne dla rodziców i dzieci, aby pomóc im w wykryciu niebezpiecznych sytuacji. Pomoże tym samym, za pomocą odpowiedniej instrukcji, odnaleźć się im w trudnej, nowej sytuacji. Apple zapewnia również, że będzie interweniowało, gdy użytkownik będzie chciał wyszukiwać tematy związane ze scamem.

Bezpieczeństwo czy inwigilacja?

Na pierwszy rzut oka, wszystko wygląda dobrze. I większość odbiorców zapewne potraktuje to jako kolejne, warte pochwały posunięcie ze strony popularnego jabłuszka. Są jednak również tacy, którzy dopatrują się w tej aktualizacji wielu zagrożeń. Prawdę mówiąc, nam również bliżej jest do tej drugiej opinii. Dlaczego? Chcąc kontrolować wiadomości wraz ze zdjęciem w iMessage, jak również scam w iCloud, Apple będzie zmuszone kontrolować każdy nasz krok. Nasza korespondencja wydaje się być nie tyle inwigilowana, co analizowana pod kątem przestępstw i odpowiednio segregowana. Specjaliści wspominają również, że niebezpieczna może okazać się współpraca z Narodowym Centrum Dzieci Zaginionych i Wykorzystywanych, ponieważ może to świadczyć o coraz bliższych stosunkach jabłka z rządem.

Czy tak rzeczywiście jest? Tak naprawdę nikt z nas nie zna dobrej odpowiedzi na to pytanie. Natomiast rzeczywiście, na ten moment ciężko jest wierzyć w czystość intencji firmy Apple.